A indústria de semicondutores enfrenta um momento crítico em 2026, com as gigantes Samsung e SK Hynix emitindo alertas consecutivos sobre a incapacidade de suprir a demanda global por memória. O foco do gargalo é a HBM (Memória de Alta Largura de Banda), componente essencial para aceleradores de inteligência artificial, cuja escassez deve se agravar nos próximos anos.

Samsung, SK Hynix e Micron controlam mais de 90% da produção global de DRAM. O alerta coordenado não é estratégia de relações com inv4estidores: é o reflexo direto de uma demanda que está consumindo capacidade produtiva antes mesmo que ela seja construída. Segundo Kim, “com base apenas na demanda já recebida para 2027, o desequilíbrio entre oferta e demanda está programado para se agravar ainda mais do que em 2026.” Alguns clientes já reservaram alocações com entrega prevista para o ano que vem. O presidente do SK Group, Chey Tae-won, foi além: sugeriu que a pressão por memória ligada a IA pode persistir até 2030, e que expandir a capacidade de produção levaria pelo menos quatro ou cinco anos, com déficits esperados acima de 20%.

O que torna o HBM tão difícil de escalar

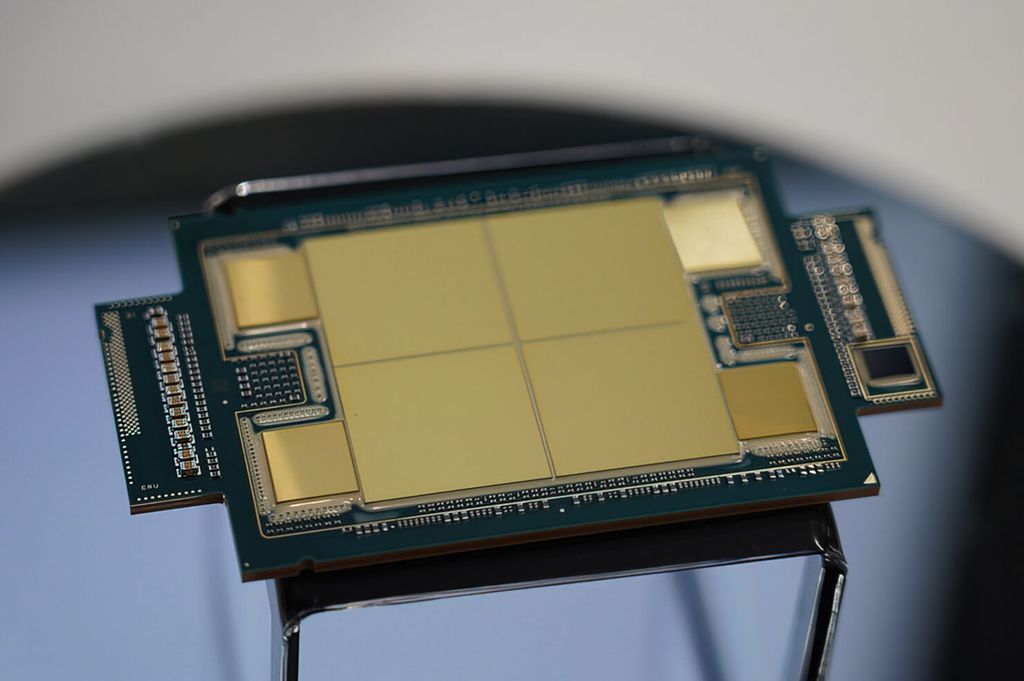

O HBM é, essencialmente, memória DRAM empilhada verticalmente, projetada para entregar largura de banda extrema enquanto permanece fisicamente colada ao processador ou acelerador. Essa proximidade é o que alimenta unidades de processamento gráfico e aceleradores com os volumes de dados que a IA exige. O problema está no processo: empilhamento de chips em múltiplas camadas, soldagem de precisão micrométrica, técnicas sofisticadas de encapsulamento. Não é possível simplesmente ligar uma nova linha de produção e esperar memória saindo no mês seguinte. O tempo de aceleração de uma fábrica leva anos — e nenhuma decisão de investimento tomada hoje resolve o problema de 2027.

O efeito colateral está se espalhando pelo mercado convencional. Como o HBM é fundamentalmente DRAM, os fabricantes estão realocando capacidade, engenharia e investimento para os produtos de maior margem. Isso comprime a oferta de DRAM padrão usada em servidores, computadores e dispositivos móveis. A demanda por unidades de armazenamento sólido corporativas também está subindo, centrais de dados de IA precisam de infraestrutura massiva de armazenamento ao lado do hardware de computação, e a SK Hynix apontou que mesmo a DRAM convencional enfrenta escassez suficiente para restringir a expansão de receita.

Você também deve ler!

Oferta 5.5 traz Echo Dot mais recente com desconto para deixar a casa mais inteligente

O que são memórias High Bandwidth Memory (HBM)

Lucros que revelam o tamanho do aperto

Para as fabricantes, a escassez tem um lado claramente positivo. A divisão de semicondutores da Samsung registrou lucro operacional de 53,7 trilhões de won no primeiro trimestre de 2026, aproximadamente 94% do lucro total da empresa no período, com receita consolidada atingindo 133,8 trilhões de won e lucro operacional de 57,2 trilhões de won, o maior resultado trimestral da história da companhia. A SK Hynix cruzou pela primeira vez a marca de 50 trilhões de won em receita num único trimestre: 52,5 trilhões de won, com lucro operacional de 37,6 trilhões de won e margem operacional de 72%. A demanda por HBM estava tão represada que, num trimestre sazonalmente fraco para memória, não só sustentou como acelerou.

Para expandir a produção, ambas as companhias aumentaram investimentos em fábricas na China. A Samsung aplicou 465,4 bilhões de won em sua planta de Xi’an em 2025, alta de 67,5% em relação ao ano anterior; a SK Hynix colocou 581,1 bilhões de won em Wuxi e outros 440,6 bilhões de won em Dalian. A Samsung também confirmou que iniciou a produção em massa de HBM4 para a plataforma Vera Rubin da Nvidia em fevereiro, com previsão de mais que triplicar a receita de HBM em 2026 em relação a 2025.

O ciclo que desta vez pode não virar

A indústria de memória é historicamente cíclica: excesso de oferta alterna com escassez numa cadência que os analistas aprenderam a antecipar. A diferença agora é que a infraestrutura de IA está consumindo hardware em taxas sem precedente histórico, e a SK Hynix disse algo que resume o tamanho do problema: pedidos de clientes por HBM já superam a capacidade de produção planejada para os próximos três anos. Não é um ciclo prestes a virar — é uma estrutura nova de demanda que as fábricas existentes simplesmente não foram construídas para atender.

O gargalo não está isolado na memória. Unidades de processamento gráfico já operam em escassez severa há mais de um ano, e a Meta apoiou projetos envolvendo energia solar orbital — satélites transmitindo eletricidade para a Terra para sustentar a demanda das centrais de dados. No campo arquitetural, tecnologias como 3D X-DRAM e ZAM (Memória em Ângulo Z) estão sendo desenvolvidas com foco em menor consumo de energia e escalabilidade além dos limites do HBM atual, mas a demanda pelas arquiteturas existentes continua avassaladora enquanto essas alternativas não chegam à produção em massa.

Em 2026, o gargalo de HBM deixa claro que a corrida da IA não é limitada apenas por poder computacional ou software — ela está batendo de frente com as leis físicas da fabricação de semicondutores. Para o mercado corporativo, o cenário imediato é de preços pressionados e disponibilidade restrita não apenas para memória de alto desempenho, mas progressivamente para toda a cadeia de DRAM.