A Anthropic iniciou negociações preliminares com a startup britânica Fractile para o fornecimento de chips de inferência, sinalizando uma mudança de foco na infraestrutura de IA: da potência bruta para a eficiência por token. A estratégia visa superar os gargalos das arquiteturas baseadas em memória DRAM externa, que atualmente encarecem e limitam a velocidade de execução de grandes modelos de linguagem.

SRAM no lugar de DRAM: o gargalo que a Fractile quer eliminar

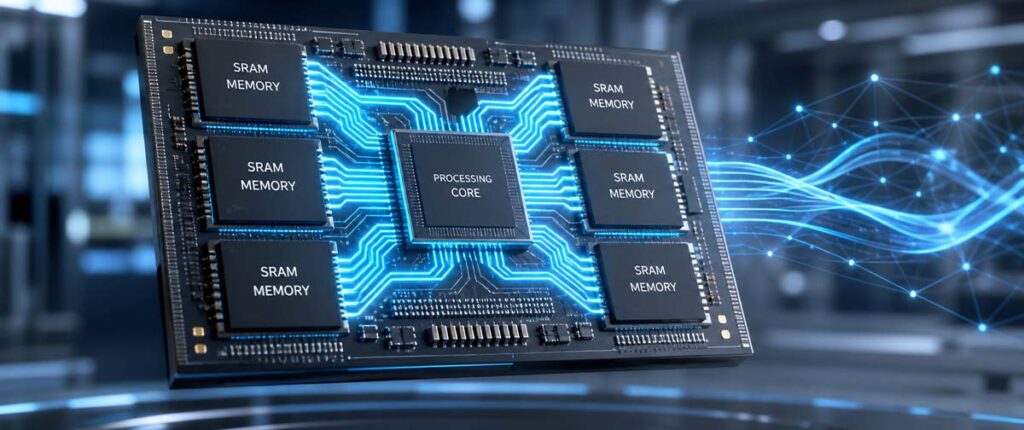

Fundada em 2022 pelo doutor em Oxford Walter Goodwin, a Fractile está desenvolvendo um acelerador de inferência que coloca memória e processamento no mesmo die, usando SRAM em vez de recorrer a chips de DRAM externos. O problema que essa abordagem tenta resolver é real e bem conhecido por quem acompanha o mercado de aceleradores: a movimentação de dados entre a GPU e a memória off-chip é um dos principais gargalos na execução de grandes modelos de linguagem em alta velocidade. Cada token gerado exige acesso constante aos pesos do modelo, e a latência dessa transferência impacta diretamente o custo operacional e a capacidade de throughput do sistema.

Em entrevista à Fortune em julho de 2024, Goodwin descreveu o design da Fractile como um arranjo em que os dados necessários para os cálculos ficam armazenados diretamente ao lado dos transistores que executam a aritmética. Com base em simulações disponíveis à época, a empresa estimava que sua arquitetura poderia rodar um modelo de linguagem 100 vezes mais rápido e 10 vezes mais barato do que GPUs da Nvidia, ainda que a empresa não tivesse fabricado chips de teste naquele momento. A previsão de prontidão comercial fica em torno de 2027, o que coloca qualquer deploy da Anthropic bem fora dos planos de curto prazo, mas dentro da mesma janela da parceria de TPUs firmada com a Google e a Broadcom.

O time da Fractile inclui engenheiros vindos de Graphcore, Nvidia e Imagination Technologies, e a empresa está construindo seu próprio stack de software junto com o hardware, o que é um diferencial crítico: chips sem software robusto não chegam a produção. A startup captou US$ 15 milhões em seed, liderados por Kindred Capital, NATO Innovation Fund e Oxford Science Enterprises, e agora está em conversas para levantar US$ 200 milhões a uma valuation superior a US$ 1 bilhão, com Founders Fund, 8VC e Accel entre os potenciais investidores.

A estratégia da Anthropic: diversificação como alavanca

Se a negociação avançar, a Fractile se tornará a quarta fonte de silício de servidor para a Anthropic, ao lado de GPUs da Nvidia, dos processadores Trainium da Amazon via Project Rainier, e das TPUs da Google. O acordo com a Google, anunciado em outubro, garantiu mais de 1 GW de capacidade de processamento, e foi expandido em abril para 3,5 GW de capacidade de TPUs para o período de 2027 a 2031. A Anthropic deliberadamente evitou dependência de um único fornecedor de chips, optando por alugar capacidade de múltiplos provedores em vez de construir ou expandir seu próprio footprint de data centers, como fazem OpenAI e xAI.

O contexto financeiro ajuda a entender a urgência. A taxa de receita anualizada da Anthropic passou de cerca de US$ 9 bilhões no final de 2025 para US$ 30 bilhões em março, um crescimento que coloca pressão brutal sobre a infraestrutura existente. Os custos de inferência têm pesado sobre as margens brutas da empresa, e a busca por aceleradores mais eficientes em custo por token deixou de ser uma aposta estratégica de longo prazo para se tornar uma necessidade operacional imediata.

Um mercado que a NVIDIA já sentiu o recado

A Fractile não está sozinha nessa aposta. Outras startups com arquiteturas SRAM-based ou de memória próxima ao compute, como Groq e Cerebras, vinham construindo tese semelhante há anos. Em dezembro, a Nvidia formalizou a aquisição da Groq por US$ 20 bilhões e, na sequência, lançou o Groq 3 LPX, seu próprio acelerador de inferência dedicado, uma admissão clara de que o mercado está cobrando otimização de custo por token em escala, e não apenas capacidade bruta de treinamento.